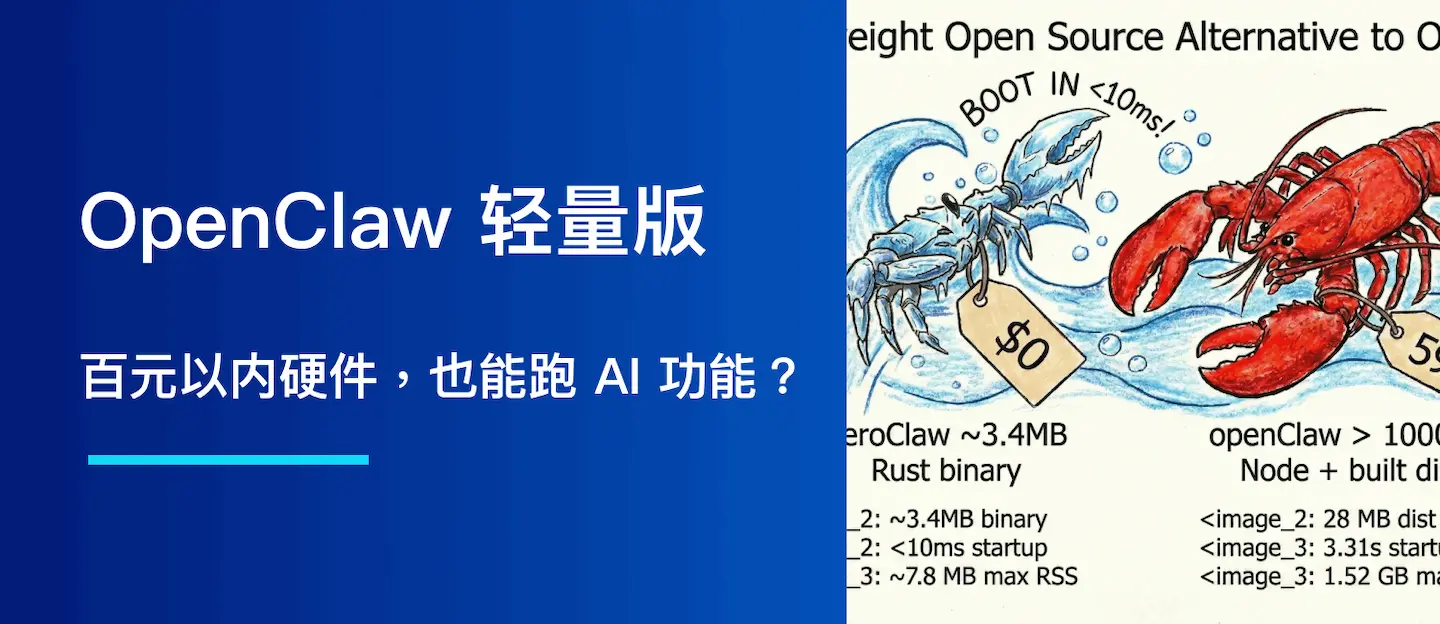

OpenClaw 轻量版来了:百元以内硬件、10MB 内存,也能跑 AI 功能?

OpenClaw 出现了多种轻量化变体,包括 Picoclaw、Zeroclaw 和 Nanobot。据称它们可在约 10MB 内存下运行。本文带你看懂这类轻量版 OpenClaw 的价值、适用场景、评估方法,以及在边缘设备、多租户和低成本环境中的部署意义。

很多 AI 功能在开发者电脑上看起来都很轻巧。

但一旦真正落到现实环境里,比如:

- 只有几十 MB 内存的设备

- 带 watchdog 的嵌入式环境

- 成本极敏感的低配实例

- 客户自管、配置不可控的硬件

原本“只是一个小功能”的东西,往往马上就会变得昂贵、脆弱,而且难以维护。

这也是为什么,最近几种 OpenClaw 轻量化变体开始值得认真关注。

从公开讨论来看,OpenClaw 目前至少出现了三种主打低内存的变体:

- Picoclaw

- Zeroclaw

- Nanobot

它们最吸引人的地方,不只是“能跑”,而是据称能把运行内存压到 约 10MB 这个级别。

注意,这里的吸引力不在于营销数字本身,而在于它背后反映出来的工程方向:

默认栈太重了,所以有人开始认真为低内存、低成本、低依赖环境做优化。

结论

- OpenClaw 的轻量化方向,核心不是“做一个更小的版本”,而是让 AI 能真正落到低成本、低内存、边缘和客户自管环境

- Picoclaw、Zeroclaw、Nanobot 说明轻量化不是单一路径,而是不同取舍下的多种工程方案

- 对很多团队来说,内存不只是技术指标,也是计费成本、启动速度、稳定性和部署范围的问题

- 如果一个 AI 组件真能稳定跑在约 10MB 内存附近,它对多租户、冷启动、边缘部署会非常有价值

- 评估轻量版 OpenClaw,不能只看“最低内存”宣传,还要看峰值 RSS、并发放大、内存压力下的失败方式和维护风险

为什么这类轻量版 OpenClaw 值得关注?

过去很多 AI 软件都默认建立在一个很舒服的前提上:

- 内存够多

- CPU 预算够宽松

- 最好旁边还有 GPU

- 依赖堆得厚一点也没关系

- 可以走容器化和重型运行时

- 监控、日志、追踪层比业务本身更重也无所谓

但今天的部署现实,正在快速变化。

1.部署现实变了

越来越多团队希望把 AI 功能放到那些原本就不适合重型栈的地方:

- 边缘盒子

- 嵌入式设备

- 工业 PC

- 自助终端

- 内部工具

- 客户自带基础设施环境

- 小规格虚拟机

- 后台 worker

这些场景共同的特点是:

资源上限是真实存在的,不能靠“再加点机器”解决。

2.成本现实变了

内存早就不只是一个技术指标,它还是一项非常直接的账单成本。

在这些场景里,额外的内存开销会快速放大:

- 多租户部署

- Serverless 任务

- 高规模 worker 集群

- 每客户独立实例

一个组件多吃几十 MB,看起来不大,但当它被复制到几十、几百、几千个实例上时,成本会非常明显。

3.运维现实变了

内存压力是生产环境里最无聊、但也最常见的故障来源之一。

例如:

- OOM 被系统杀死

- 碎片化导致性能异常

- 缓慢内存泄漏

- 本地测试看起来没问题,线上一上压力就出事

所以,当一个轻量版 OpenClaw 被描述为“最低约 10MB 内存可运行”时,它真正传达的价值,不只是规格参数,而是:

有人开始认真做低内存约束下的 AI 工程。

Picoclaw、Zeroclaw、Nanobot 说明了什么?

如果只是一个单独的“lite 版本”,很多人第一反应可能会是:

“这不过是删掉一些功能、关掉几个依赖、换几个编译参数。”

但如果同时出现三种轻量化变体,这就说明一件更有意思的事:

轻量化本身就是一个设计空间。

这通常意味着:

- 不同项目做了不同取舍

- 优先优化的约束并不一样

- 目标运行环境可能也不完全相同

换句话说,轻量化不是一个单点技巧,而是一整套架构选择。

而这类“10MB 思维”会逼你正视很多 AI 工程里平时容易忽略的问题:

- 隐性的运行时开销

- 不必要的内存分配

- 默认无上限的缓存

- 序列化和反序列化膨胀

- 日志和追踪负载

- 并发带来的内存乘数效应

- 以及经典问题:每次请求都重新加载一遍

这些问题在开发环境中不一定明显,但一旦进入生产环境,往往就是最先暴露的隐患。

哪些场景会立刻受益?

1.多租户环境里的 AI Sidecar

如果你的部署方式是:

- 每个客户一个实例

- 每个命名空间一个实例

- 每个节点一个实例

那么组件的内存占用,几乎会被直接乘上实例数量。

这时候,10MB 到 50MB 的差距,不是“小优化”,而是:

系统到底能不能健康扩容。

2.冷启动正在拖垮用户体验

在 Serverless、弹性扩缩容和按需启动的场景中,内存开销通常与这些问题高度相关:

- 启动时间

- 镜像体积

- 首次响应时间

- Time-to-First-Token

如果组件本身够轻,冷启动往往也更容易优化。

3.你想把 AI 功能部署到客户的受限硬件

很多真实场景并不是跑在理想云环境中,而是跑在这些地方:

- 路由器

- 工业电脑

- 瘦虚拟机

- 隔离内网环境

- 需要离线运行的设备

理论上你也可以要求客户“多给一点内存”,但现实里这其实是一种额外税负:

- 采购周期更长

- 硬件成本更高

- 故障模式更多

- 部署范围更窄

怎么评估轻量版 OpenClaw?

评估这类项目时,我更关心的不是一句“最低 10MB RAM”,而是以下四件事:

- 实际内存行为

- 内存压力下的失败模式

- 运维适配度

- 长期维护风险

因为在真实系统里,“10MB 内存”几乎从来不是一个干净数字。

它会随着统计口径变化而变化,比如:

- 你是在看启动瞬间,还是稳态运行?

- 你看的是 RSS、虚拟内存,还是映射页?

- 你算不算分配器冗余和缓存?

- 你的测试工具本身吃掉了多少内存?

所以,最重要的不是宣传数字,而是统一测量方法。

一个简单但实用的评估方法

下面是一套很适合做轻量组件对比的思路。

Step 1:先测峰值 RSS 和运行时间

在 Linux 下,可以先用 time -v 做一个非常朴素但很实用的基准。

#!/usr/bin/env bash

set -euo pipefail

CMD="${1:?Usage: bench_mem.sh '<command to run>'}"

# /usr/bin/time -v 会输出 Maximum resident set size (kbytes)

/usr/bin/time -v bash -lc "$CMD" 2>&1 | tee /tmp/mem_bench.out

echo

echo "---- Extract ----"

grep -E "Maximum resident set size|Elapsed" /tmp/mem_bench.out || true

例如你可以这样测:

./bench_mem.sh "./picoclaw --help"

./bench_mem.sh "./zeroclaw --version"

./bench_mem.sh "./nanobot --help"

这类测试虽然简单,但足够用来做第一轮筛选。

Step 2:人为设置内存上限,尽早暴露问题

我很推荐尽早加一层内存限制,因为它能很快暴露那些“平时没事,一压就崩”的分配行为。

例如:

# 把虚拟内存限制在约 20MB(单位 KB)

ulimit -v 20480 ./your_command_here

这当然不是一个完美的 RSS 模型,但它可以快速帮助你判断:

- 程序是否会优雅失败?

- 还是会在中途崩溃,并抛出一堆难以理解的错误?

对于产品化部署来说,这种差别非常关键。

Step 3:测试并发放大效应

很多组件单实例看起来很轻,但一上并发就不是那个量级了。

真实占用往往更像这样:

总内存 = 基础占用 +(每请求缓冲区 × 并发请求数)

所以最好做一轮并发测试,例如:

for c in 1 2 4 8 16; do

echo "=== concurrency=$c ==="

./bench_mem.sh "./your_service --concurrency $c --run-sample-workload"

done

这一步能非常快地看出:

- 它是不是只适合单用户测试环境

- 它在生产并发下是否还成立

我会重点看哪些指标?

内存行为

- 峰值 RSS 是否在可接受范围

- 稳态内存是否稳定,有没有慢性泄漏

- 缓存是否有明确上限

- 并发增加后,内存增长是否可解释

运维行为

- 内存吃紧时是否优雅失败

- 冷启动成本是否可测可控

- 日志和追踪能否在不改代码的前提下调低

- 有没有隐藏的后台线程或不可预期分配

产品风险

- 项目是否有持续维护信号

- 许可证是否清晰

- 集成方式是否适配你的技术栈

- 未来如果切换方案,迁移成本高不高

那到底该选 Picoclaw、Zeroclaw 还是 Nanobot?

现阶段,与其问“哪一个绝对最好”,不如先问三个更实际的问题。

1.你要的到底是兼容性,还是能力本身?

你首先要判断:

- 你是否需要和标准 OpenClaw 维持尽可能高的兼容性?

- 还是你只想在更小资源包络下获得类似能力?

这两个目标看起来相似,但在工程上可能完全不同。

2.你到底在构建什么系统?

不同系统,对轻量组件的要求完全不同。

如果你做的是:

- 偏嵌入式系统:更在意确定性的内存表现和可预测的失败模式

- 多租户服务:更在意单实例成本和并发扩展

- 客户端应用:更在意启动速度、电量和后台占用

所以,别把它当成一场“谁更美”的评比,而要把它看成不同约束下的候选组合。

3.把三个版本当作一个候选池,而不是一场选美

更成熟的做法通常是:

- 先挑两个版本做原型

- 用同一套测试方法跑通

- 对比内存、延迟、失败模式

- 再选出最适合你当前约束的那个

另外两个也不要完全放弃,它们可以作为后续的备选路径。

我对这类轻量版 OpenClaw 的看法

如果你从来没有做过严格内存预算下的交付,很容易把“内存优化”放到最后。

但现实往往是,一旦你的架构从一开始就建立在重型运行时之上,后面的产品路线也会被一起绑定:

- 机器规格越来越大

- 可部署的环境越来越少

- 运维脆弱性越来越强

- 扩容成本越来越高

- “测试环境没问题”这种幻觉越来越多

所以,当我看到围绕 OpenClaw 同时出现多个约 10MB 级别的轻量化变体时,我更愿意把它理解成一个明确的信号:

默认栈对于下一阶段想落地的场景来说,已经太重了。

即便 OpenClaw 最终的技术路线与你当前产品不完全一致,这种趋势本身依然值得关注。

因为真正有竞争力的产品团队,往往会尽早把约束显性化,而不是等到线上出问题才被迫补课。

总结

你不一定非要做微控制器项目,才需要关心内存纪律。

只要你做的是需要“尽可能部署到更多环境”的 AI 功能,那么这类轻量版 OpenClaw 都值得进入评估名单。

Picoclaw、Zeroclaw 和 Nanobot 的意义,不只是它们更小,而是它们提醒了整个 AI 工程领域一件事:

真正的产品化,不是把功能做出来,而是把功能放进现实约束里还能稳定运行。

如果接下来你的产品还想进入更多终端、更多边缘环境、更多客户自管场景,那么低内存、低依赖、低开销,不会是可选项,而会越来越像基本要求。

联系我们

有任何云成本管理、AI 成本治理或企业 AI 落地相关需求,欢迎通过以下方式联系我们!

公众号

企业微信客服

业务咨询

技术社区

地址

北京市海淀区自主创新大厦 5层